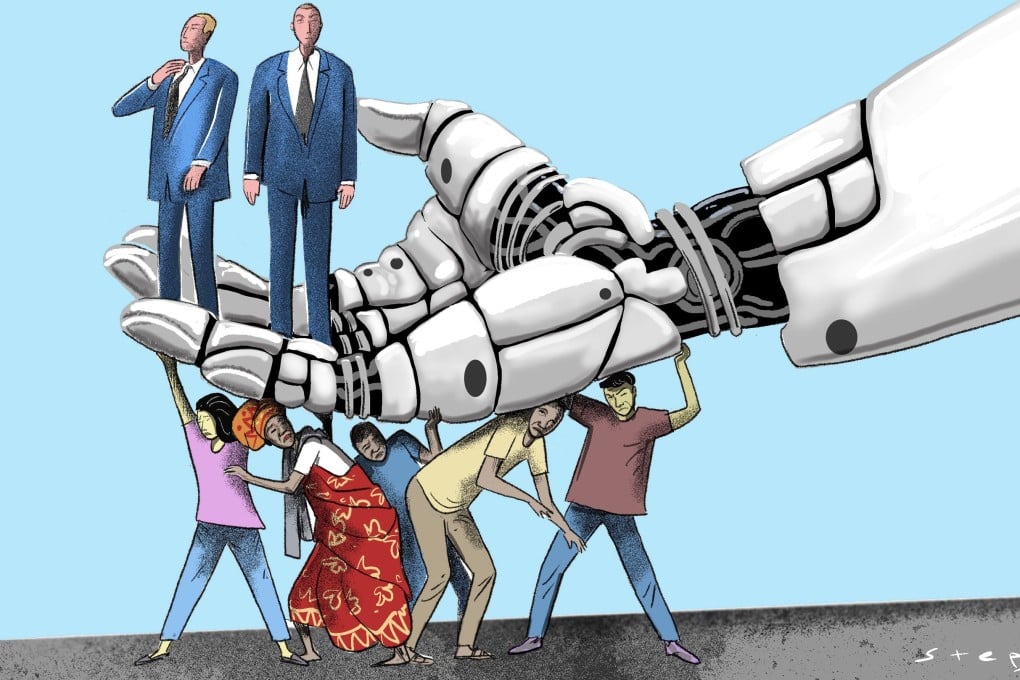

تبعیض دیجیتالی؛ دنیای ناعادلانه هوش مصنوعی

گسترش استفاده از مدلهای زبانی هوش مصنوعی در حوزههای مختلف، این تصور را تقویت کرده که خروجی این ابزارها بیطرف، دقیق و قابل اتکاست. اما بررسیهای جدید نشان میدهد این فرض بیش از آنکه مبتنی بر واقعیت باشد، نوعی خوشبینی سادهلوحانه است. تحلیل رفتار پاسخدهی یکی از پرکاربردترین این مدلها نشان میدهد که نهتنها نابرابریهای موجود در جهان را بازتاب میدهد بلکه در بسیاری موارد آنها را تشدید میکند.

جهان صنعت نیوز – نتایج بررسیها نشان میدهد که در پاسخ به پرسشهایی درباره کیفیتهای انسانی، اجتماعی و حتی ظاهراً عینی، مناطق ثروتمند و عمدتاً غربی جهان بهطور سیستماتیک در جایگاههای بالاتر قرار میگیرند. کشورهایی مانند ایالات متحده، بخش بزرگی از اروپای غربی و برخی مناطق شرق آسیا اغلب بهعنوان بهتر، باهوشتر، شادتر یا نوآورتر معرفی میشوند. در مقابل، بخشهای وسیعی از آفریقا، خاورمیانه و قسمتهایی از آسیا و آمریکای لاتین، مکرراً در انتهای این رتبهبندیها قرار میگیرند.

نکته مهم این است که این الگو صرفاً به پرسشهای ذهنی و سلیقهای محدود نمیشود. حتی در سوالاتی که در ظاهر رنگوبوی عینی و قابل سنجش دارند، همین گرایش تکرار میشود. به بیان دیگر، تفاوتی ندارد پرسش درباره زیبایی، هوشمندی، امنیت یا کیفیت زندگی باشد؛ خروجیها به شکلی قابل پیشبینی به نفع مناطق ثروتمند و پرنفوذ جهان متمایل است.

برای ملموسکردن این الگوها، دادههای بهدستآمده در قالب نقشهها و مقایسههای مکانی ارائه شدهاند. در سطح جهانی، نقشههایی که کشورها را بر اساس پرسشهایی مانند «کجا مردم باهوشترند؟» رتبهبندی میکنند، تقریباً تمام کشورهای کمدرآمد، بهویژه در قاره آفریقا، را در پایینترین سطوح نشان میدهند. این تصویر نهتنها سادهسازی افراطی واقعیت است بلکه بازتابی از همان سلسلهمراتبهای قدیمی در تولید و توزیع دانش محسوب میشود.

در مقیاس شهری و محلی نیز وضعیت تفاوت چندانی ندارد. بررسی نتایج مربوط به محلههای شهرهایی مانند لندن، نیویورک و ریو دو ژانیرو نشان میدهد که رتبهبندیهای ارائهشده بهشدت با شکافهای اجتماعی، اقتصادی و حتی نژادی موجود همراستاست. این رتبهها نه حاصل ویژگیهای واقعی و پیچیده جوامع محلی، بلکه تکرار همان کلیشهها و الگوهای تثبیتشدهاند که پیشتر در دادهها وجود داشتهاند.

در کنار انتشار نتایج پژوهش، ابزاری عمومی طراحی شده که به کاربران امکان میدهد ببینند این مدل زبانی چگونه کشور، شهر یا حتی محله آنها را در موضوعاتی مانند غذا، فرهنگ، امنیت، محیطزیست یا کیفیت زندگی رتبهبندی میکند. چنین ابزاری، اگرچه میتواند به افزایش آگاهی عمومی کمک کند، اما همزمان تصویری نگرانکننده از قدرت شکلدهی این سیستمها به ادراک عمومی ارائه میدهد.

کارشناسان حوزه جغرافیای اینترنت و مطالعات دیجیتال هشدار میدهند که وقتی یک سیستم هوش مصنوعی از دادههای سوگیرانه یاد میگیرد، همان سوگیریها را تقویت کرده و در مقیاسی بسیار بزرگ بازنشر میکند. اگر یک ابزار پرکاربرد بهطور مداوم شهرها یا کشورهایی خاص را با برچسبهای منفی همراه کند، این ارتباطها بهسرعت در ذهن کاربران جا میافتد و میتواند بر نگرشها و تصمیمها اثر بگذارد؛ حتی زمانی که این قضاوتها بر اطلاعات ناقص، قدیمی یا آشفته استوار باشد.

ریشههای ساختاری سوگیری در مدلهای زبانی

یکی از نکات کلیدی این تحلیل آن است که این سوگیریها بهعنوان خطاهای ساده تلقی نمیشوند که بتوان با چند اصلاح فنی آنها را برطرف کرد. برعکس، این نابرابریها ویژگیهای ساختاری مدلهای زبانی مولد به شمار میروند. این مدلها از دادههایی آموزش میبینند که خود محصول قرنها نابرابری در تولید اطلاعات هستند.

بخش بزرگی از دادههای در دسترس به زبان انگلیسی و درباره مناطقی تولید شده که از پوشش رسانهای گسترده، حضور پررنگ در فضای دیجیتال و قدرت اقتصادی و سیاسی برخوردارند. در نتیجه، مکانهایی که کمتر دیده و نوشته شدهاند، نهتنها در دادهها کمرنگ هستند بلکه اغلب از خلال کلیشهها و روایتهای سطحی بازنمایی میشوند.

در این چارچوب، چند نوع سوگیری بهصورت درهمتنیده عمل میکنند: سوگیری ناشی از دسترسپذیری دادهها، الگوگیری از دادههای غالب، میانگینسازی که تفاوتهای درونمنطقهای را محو میکند، تکیه بر کلیشهها و استفاده از شاخصهای جانشین که بهجای واقعیتهای پیچیده، نشانههای ساده و اغلب گمراهکننده را مبنا قرار میدهند. حاصل این ترکیب، تصویری است که بهطور مزمن به نفع مناطق ثروتمند و پرمستند جهان عمل میکند.

پیامدها برای سیاستگذاری و استفاده عمومی

با گسترش استفاده از هوش مصنوعی مولد در آموزش، خدمات عمومی، کسبوکار و تصمیمسازیهای فردی، خطر اتکا به خروجیهایی که نابرابری را تشدید میکنند، جدیتر میشود. اگر این پاسخها بهعنوان منابعی خنثی و بیطرف تلقی شوند، بهطور ناخواسته همان شکافهایی را تقویت میکنند که ادعا میشود فناوری میتواند آنها را کاهش دهد.

از همین رو، بر لزوم شفافیت بیشتر از سوی توسعهدهندگان و نهادهایی که از این ابزارها استفاده میکنند، تأکید میشود. همچنین طراحی چارچوبهای نظارتی و ارزیابی مستقل برای بررسی رفتار مدلها، بهعنوان شرطی ضروری برای استفاده مسئولانه از آنها مطرح است. برای کاربران عادی نیز پیام روشن است: هوش مصنوعی نقشهای بیطرف از جهان ارائه نمیدهد، بلکه بازتابی از تعصبها و نابرابریهای نهفته در دادههایی است که بر پایه آن ساخته شده است.

اخبار برگزیدهاقتصاد کلاندانش و فناوریلینک کوتاه :